NVIDIA Clean quét điểm benchmark MLPerf AI với GPU Hopper H100, Tăng hiệu suất lên tới 4,5 lần so với Ampere A100

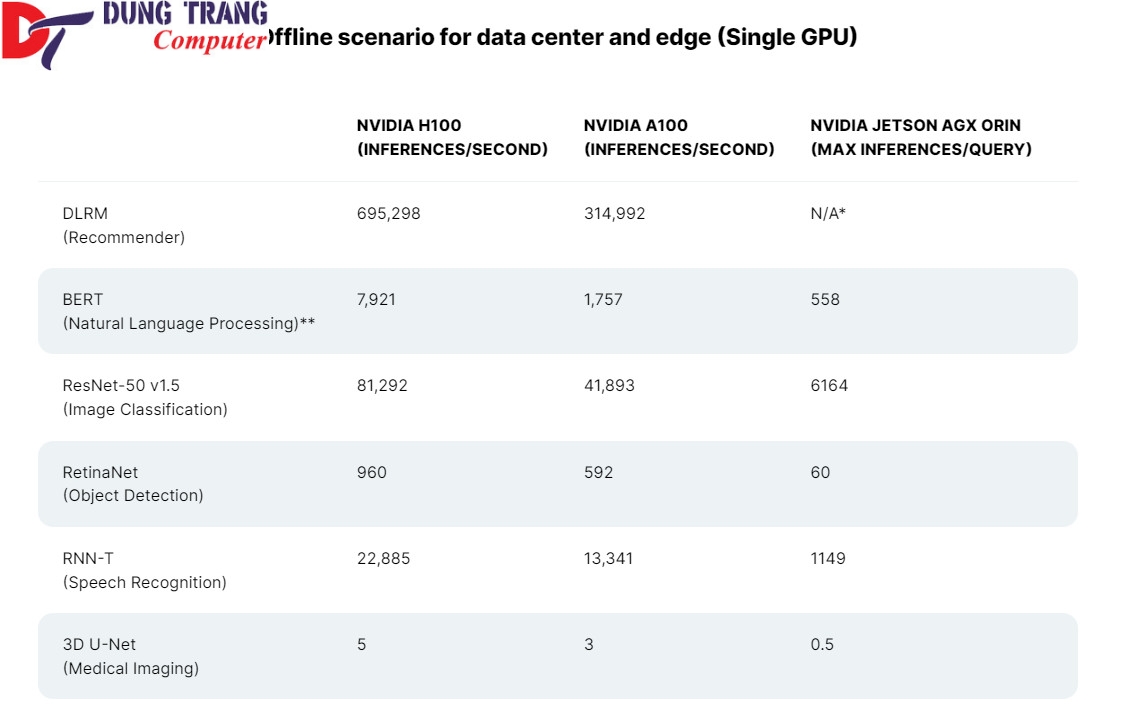

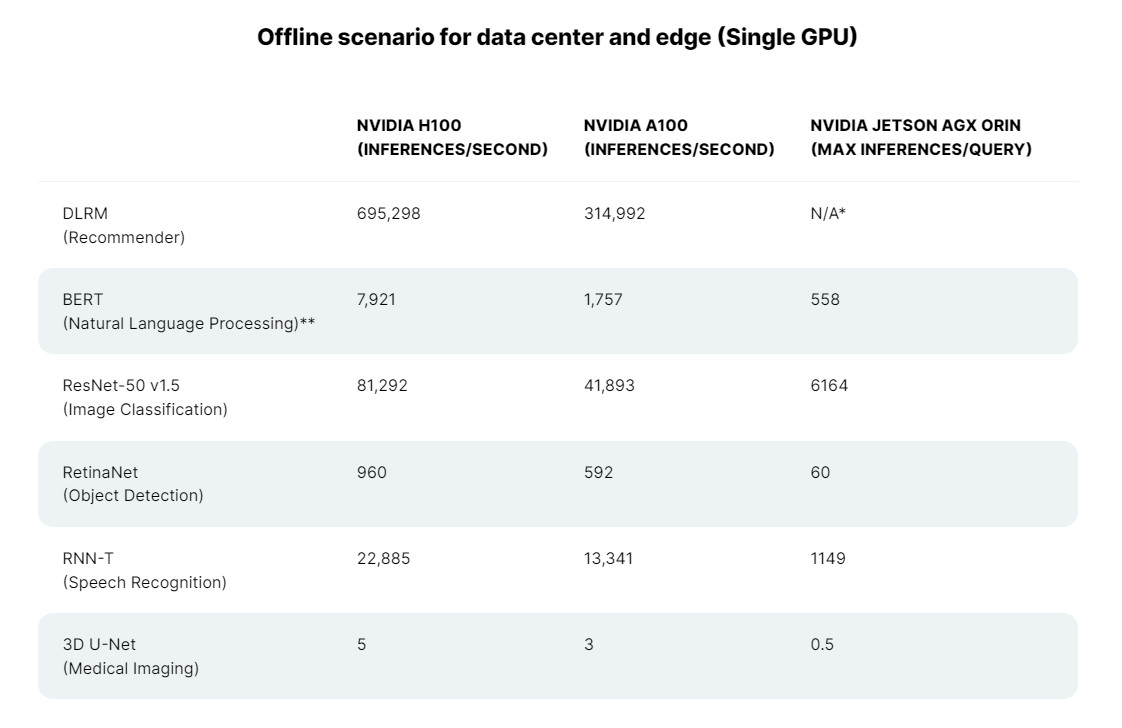

GPU Hopper H100 của NVIDIA đã xuất hiện lần đầu trên danh sách MLPerf AI Benchmark và phá vỡ mọi kỷ lục trước đó của Ampere A100. Trong khi GPU Hopper Tensor Core mở đường cho cuộc cách mạng AI lớn tiếp theo, GPU Ampere A100 tiếp tục thể hiện hiệu suất dẫn đầu trong bộ ứng dụng AI chính thống trong khi Jetson AGX Orin dẫn đầu trong lĩnh vực điện toán biên.

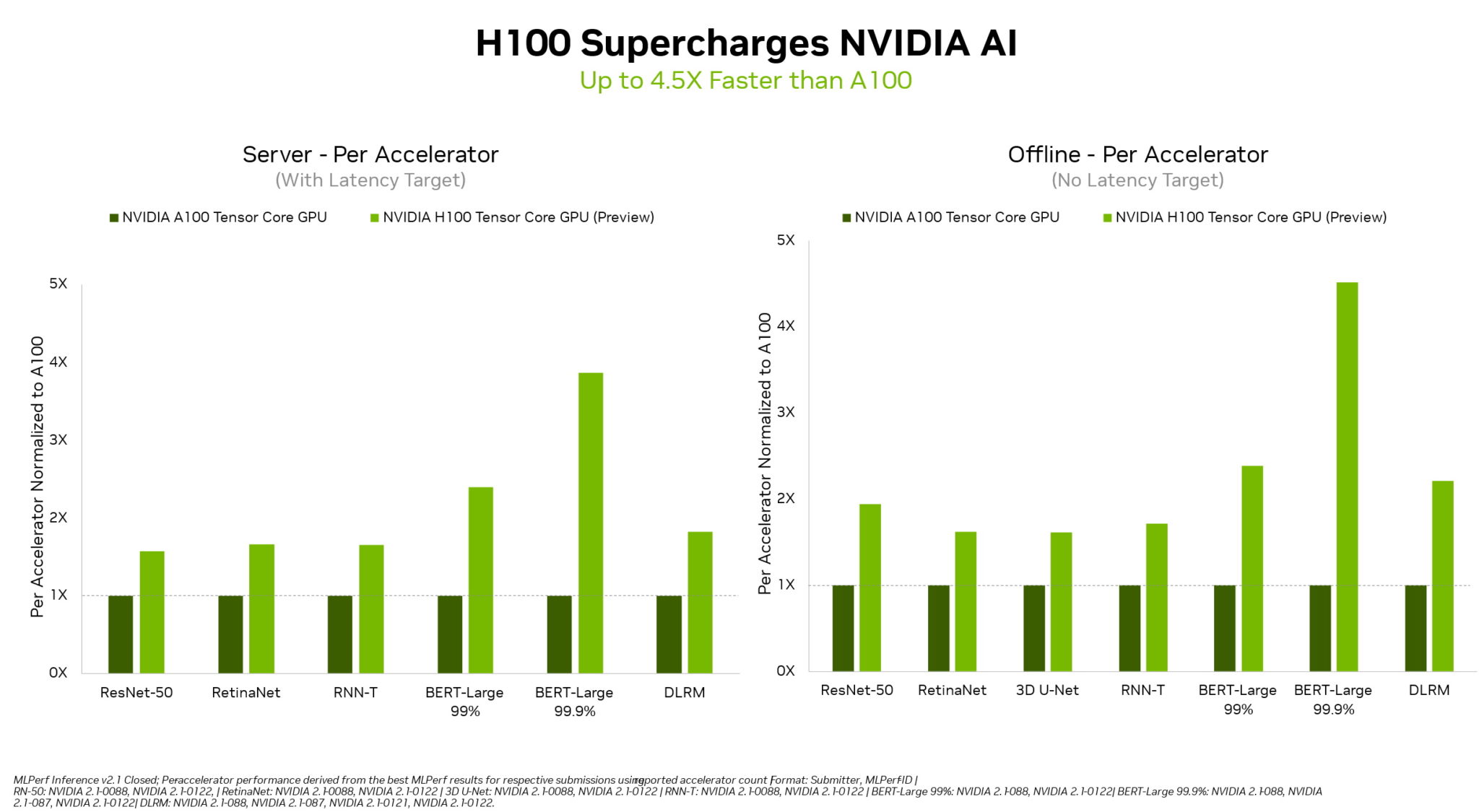

Cuộc cách mạng AI của NVIDIA tiếp tục với GPU lõi Tensor H100 Hopper H100 phá vỡ tất cả các điểm benchmark MLPerf, cung cấp mức tăng hiệu suất lên tới 4,5 lần so với thế hệ trước.

Thông cáo báo chí: Trong lần ra mắt đầu tiên trên điểm benchmark AI tiêu chuẩn ngành MLPerf, GPU NVIDIA H100 Tensor Core đã lập kỷ lục thế giới về khả năng suy luận trên tất cả các workloads, mang lại hiệu suất gấp 4,5 lần so với GPU thế hệ trước. Kết quả cho thấy Hopper là sự lựa chọn cao cấp cho những người dùng yêu cầu hiệu suất cao nhất trên các advanced AI models.

Ngoài ra, GPU NVIDIA A100 Tensor Core và mô-đun NVIDIA Jetson AGX Orin dành cho robot được hỗ trợ bởi AI tiếp tục mang lại hiệu suất suy luận lãnh đạo tổng thể trên tất cả các bài kiểm tra MLPerf: nhận dạng hình ảnh và giọng nói, xử lý ngôn ngữ tự nhiên và hệ thống đề xuất.

H100, hay còn gọi là Hopper, đã nâng cao hiệu suất trên mỗi máy gia tốc trên tất cả sáu mạng nơ-ron trong vòng. Nó thể hiện sự dẫn đầu về cả thông lượng và tốc độ trong một máy chủ riêng biệt và các kịch bản ngoại tuyến (offline scenarios). Kiến trúc NVIDIA Hopper mang lại hiệu suất cao hơn gấp 4,5 lần so với GPU kiến trúc NVIDIA Ampere, tiếp tục cung cấp vị trí dẫn đầu tổng thể về kết quả MLPerf.

Một phần nhờ Transformer Engine, Hopper đã xuất sắc trên mô hình BERT phổ biến để xử lý ngôn ngữ tự nhiên. Đây là một trong những mô hình lớn nhất và có hiệu suất cao nhất trong số các mô hình MLPerf AI. Các điểm benchmark suy luận này đánh dấu lần trình diễn công khai đầu tiên của GPU H100, sẽ ra mắt vào cuối năm nay. Các GPU H100 sẽ tham gia vào các vòng MLPerf trong tương lai để đào tạo.

A100 GPUs Show Leadership

GPU NVIDIA A100, có sẵn ngày hôm nay từ các nhà sản xuất hệ thống và nhà cung cấp dịch vụ đám mây lớn, tiếp tục thể hiện sự dẫn đầu tổng thể về hiệu suất chủ đạo trên suy luận AI trong các thử nghiệm mới nhất. GPU A100 đã giành được nhiều bài kiểm tra hơn bất kỳ bài gửi nào trong các danh mục và kịch bản của trung tâm dữ liệu và điện toán biên. Vào tháng 6, A100 cũng dẫn đầu tổng thể về các tiêu chuẩn đào tạo MLPerf, thể hiện khả năng của nó trong toàn bộ quy trình làm việc của AI.

Kể từ lần đầu ra mắt vào tháng 7 năm 2020 trên MLPerf, GPU A100 đã nâng cao hiệu suất gấp 6 lần nhờ những cải tiến liên tục trong phần mềm NVIDIA AI. NVIDIA AI là nền tảng duy nhất để chạy tất cả khối lượng công việc và kịch bản suy luận MLPerf trong trung tâm dữ liệu và điện toán biên.

Người dùng cần hiệu suất linh hoạt

Khả năng GPU NVIDIA mang lại hiệu suất dẫn đầu trên tất cả các mô hình AI chính khiến người dùng trở thành người chiến thắng thực sự. Các ứng dụng trong thế giới thực của họ thường sử dụng nhiều mạng nơ-ron các loại khác nhau.

Ví dụ: một ứng dụng AI có thể cần hiểu yêu cầu bằng giọng nói của người dùng, phân loại hình ảnh, đưa ra đề xuất và sau đó đưa ra phản hồi dưới dạng tin nhắn nói bằng giọng nói của con người. Mỗi bước yêu cầu một loại mô hình AI khác nhau.

Các điểm benchmark MLPerf bao gồm các khối lượng công việc và kịch bản AI phổ biến khác – tầm nhìn máy tính, xử lý ngôn ngữ tự nhiên, hệ thống đề xuất, nhận dạng giọng nói, v.v. Các bài kiểm tra đảm bảo người dùng sẽ nhận được hiệu suất đáng tin cậy và linh hoạt để triển khai.

Người dùng dựa vào kết quả MLPerf để đưa ra quyết định mua sáng suốt vì các bài kiểm tra là minh bạch và khách quan. Các điểm benchmark nhận được sự ủng hộ từ một nhóm rộng lớn bao gồm Amazon, Arm, Baidu, Google, Harvard, Intel, Meta, Microsoft, Stanford và Đại học Toronto.

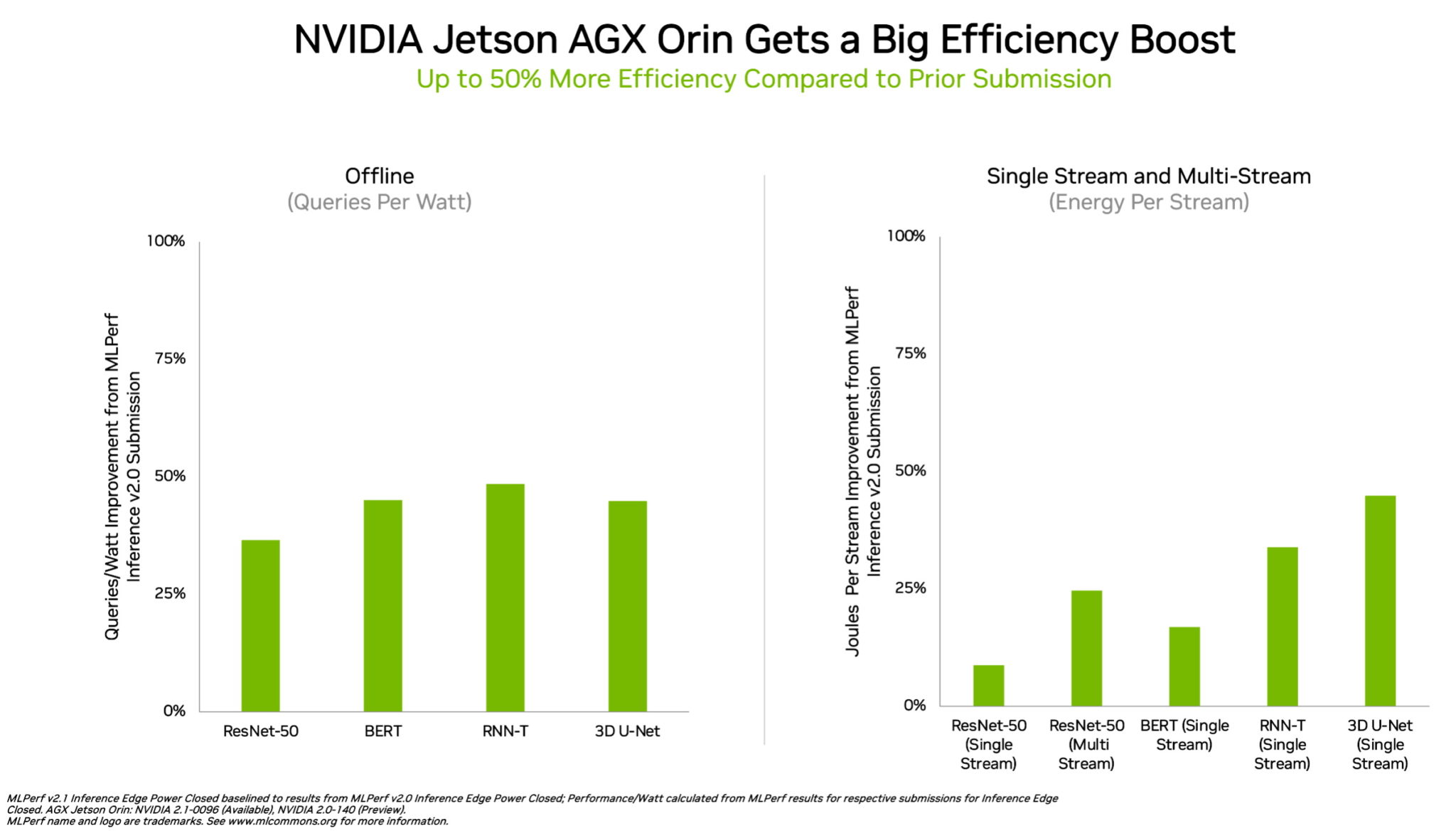

Orin Leads at the Edge

Trong lĩnh vực điện toán biên, NVIDIA Orin đã chạy mọi điểm benchnak MLPerf, chiến thắng nhiều bài kiểm tra hơn bất kỳ hệ thống trên một chip tiêu thụ điện năng thấp nào khác. Và nó đã cho thấy hiệu suất năng lượng tăng tới 50% so với lần đầu ra mắt trên MLPerf vào tháng Tư. Trong vòng trước, Orin đã chạy nhanh hơn gấp 5 lần so với mô-đun Jetson AGX Xavier thế hệ trước, đồng thời mang lại hiệu suất năng lượng tốt hơn trung bình gấp 2 lần.

Orin tích hợp vào một chip duy nhất GPU kiến trúc NVIDIA Ampere và một cụm lõi CPU Arm mạnh mẽ. Nó có sẵn ngày hôm nay trong bộ công cụ dành cho nhà phát triển NVIDIA Jetson AGX Orin và các mô-đun sản xuất cho robot và hệ thống tự hành, đồng thời hỗ trợ toàn bộ phần mềm NVIDIA AI, bao gồm các nền tảng cho xe tự hành (NVIDIA Hyperion), thiết bị y tế (Clara Holoscan) và robot (Isaac).